Ulrike Hanke, Annette Glathe, Florian Klapproth, Martina Mörth, Hiltraut Paridon &Tobias Weber

Zwischen warnenden Stimmen, die den Untergang des kritischen Denkens prognostizieren, und euphorischen Berichten über kreative Produktivitätsschübe scheint bei der Diskussion über die Auswirkungen künstlicher Intelligenz kaum Raum für Zwischentöne zu bleiben. Doch gerade darauf sollten wir als Lehrende schauen: Denn ob KI das Denken behindert oder fördert, hängt – wie wir in diesem Blogbeitrag zeigen möchten – weniger davon ab, ob sie genutzt wird, sondern vielmehr wie.

Vom Schwarz-Weiß-Denken zum Kontinuum

Die Forschung zeigt widersprüchliche Ergebnisse: In manchen Studien scheint KI das Lernen zu verhindern und dem kritischen Denken zu schaden (z.B. Bastani et al, 2024; Gerlich, 2024), in anderen unterstützt sie diese Prozesse (z.B. Abbas, Jam & Khan, 2024; Kavadella et al, 2024; Essel et al, 2024).

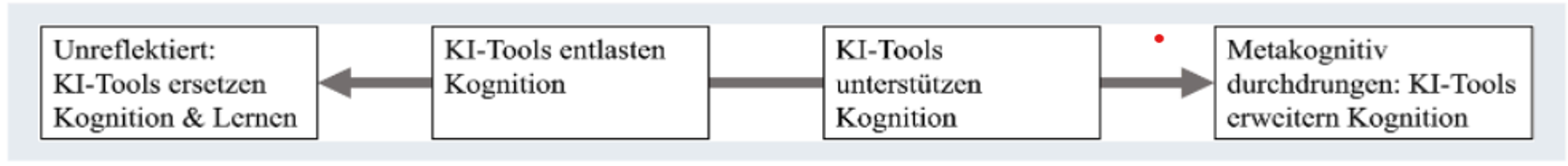

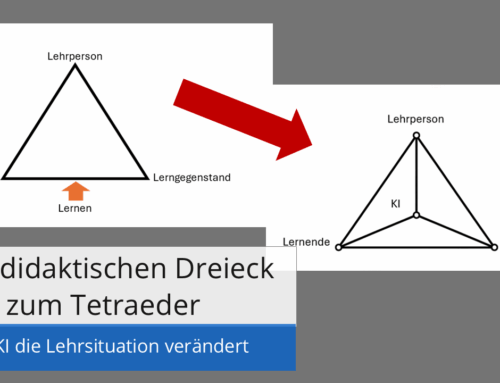

Buck und Limburg haben deshalb bereits 2024 vorgeschlagen, nicht in dichotomen Kategorien zu denken, sondern in einem Kontinuum (vgl. Abb. 1): von unreflektierter Nutzung, über entlastende und unterstützende Anwendung, bis hin zu einer metakognitiven Erweiterung des Denkens.

Abb. 1: Einsatzszenarien von KI im Schreibprozess (aus: Buck & Limburg, 2024, S. 11)

In diesem Sinne kann KI ein Werkzeug werden, das kognitive Prozesse unterstützt, herausfordert und neue Aspekte einbringt, wenn es richtig eingesetzt wird. Wenn die KI jedoch Aufgaben vollständig übernimmt, werden Denkprozesse ausgelagert (Stichwort: Offloading) – es wird nicht gelernt, sondern nur Lösungen generiert.

Als Teilgruppe innerhalb der Arbeitsgruppe Psychologie und Lehr-Lernpsychologie in der Deutschen Gesellschaft für Hochschuldidaktik (dghd) haben wir uns im vergangenen Jahr intensiv mit aktueller Forschung rund um das Thema „Lernen und Schreiben mit KI“ beschäftigt und zahlreiche Ergebnisse zusammengetragen. Mit einem prozessorientierten Blick auf diese Studien ist es uns gelungen, die scheinbar widersprüchlichen Befunde psychologisch zu beschreiben (siehe unser Vortrag auf dem University Future Festival). Im weiteren Verlauf ist daraus auf Basis solider psychologischer Erkenntnisse zum Wissenserwerb und zum Gedächtnis (Renkl, 2020; Richter & Kubik, 2025) ein Modell entstanden, mit dem sich veranschaulichen lässt, wann der KI-Einsatz beim wissenschaftlichen Schreiben Lernen verhindert und wann er es verbessert. Dieses Modell kann helfen, Maßnahmen für Lehrende abzuleiten, um Studierende zu befähigen, KI beim Schreiben lernförderlich zu nutzen. Wir stellen Ihnen dieses Modell im vorliegenden Blogbeitrag vor.

Wie Schreiben mit und ohne KI funktioniert

Schreiben ist ein Prozess der sogenannten externalen Modellbildung (Hanke, 2007): Um ein Schreibprodukt – also ein externales Modell – zu entwickeln nutzen die Schreibenden einerseits mentale Modelle und Wissenseinheiten im Arbeits- und Langzeitgedächtnis und andererseits externe Quellen.

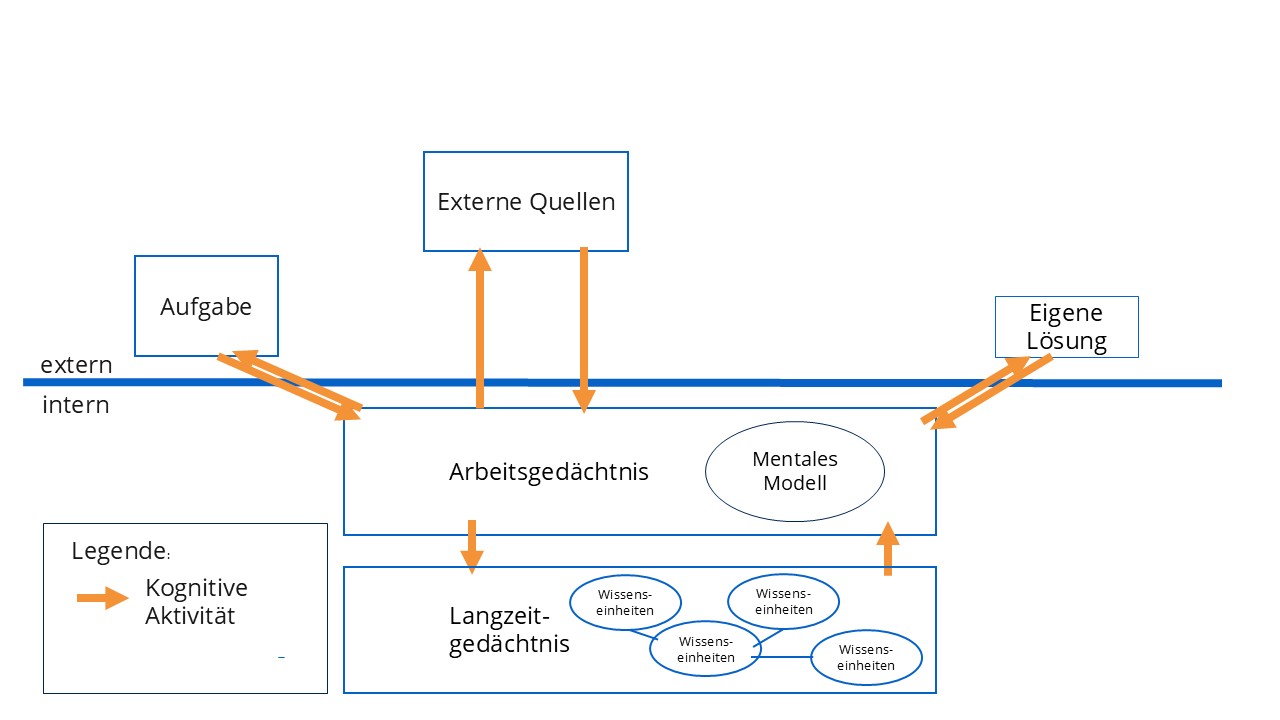

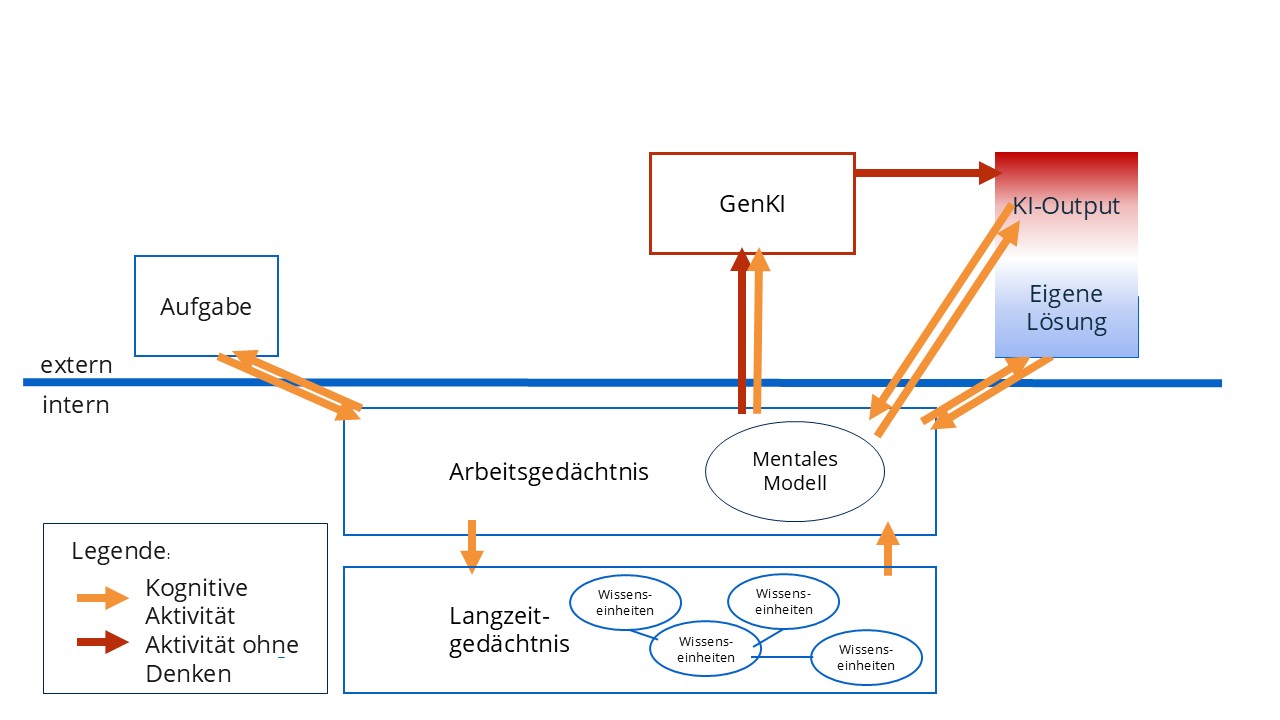

Auslöser für einen Schreibprozess ist in der Regel ein von extern angestoßener Auftrag (z.B. eine Hausarbeit zu schreiben) (vgl. Abb. 2). Diese Aufgabe wird, immer wenn Studierende sich damit beschäftigen und darüber nachdenken, in ihrem Arbeitsgedächtnis unter Rückgriff auf ihr Wissen aus dem Langzeitgedächtnis in Form eines mentalen Modells repräsentiert und verfeinert. Meist rufen sie dann auch externe Quellen (wie wissenschaftliche Publikationen etc.) ab, verarbeiten diese im Arbeits- und Langzeitgedächtnis und arbeiten so weiter an ihrem mentalen Modell, also quasi ihrer Lösung zum Schreibauftrag. Irgendwann beginnen sie dann, erste Ideen aufzuschreiben, also zu externalisieren. Dabei entstehen die ersten Züge des Schreibproduktes (d.h. des externalen Modells). Dieses externalisierte Schreibprodukt führt seinerseits durch wiederholtes Lesen, Nachdenken und Überarbeiten wiederum im Arbeitsgedächtnis in Wechselwirkung mit dem Langzeitgedächtnis dazu, dass die Schreibenden ihr mentales Modell auf der Grundlage ihres vorläufigen Schreibproduktes weiterentwickeln. Dieser Rückkoppelungsprozess führt also zu einer „Verfestigung der Gedanken beim Schreiben“ (Kleist, 1805/06). Gleichzeitig lernen die Schreibenden natürlich auch, denn neue Erkenntnisse aus dem Schreibprozess speichern sie im Langzeitgedächtnis.

Abb. 2: Modell des Schreibens in Anlehnung an das Modell des epistemischen Externalisierens von Hanke, 2007

Durch diese beim Schreiben vielfach ablaufenden kognitiven Prozesse des Repräsentierens, Abrufens, Externalisierens, Re-Repräsentierens, Prüfens, Veränderns und Erweiterns entsteht einerseits das Schreibprodukt (externales Modell) und findet andererseits Lernen statt. Schreiben kann Denken demnach unterstützen und Lernen auslösen. Gleichzeitig ist Denken und gelerntes Wissen aber auch die Basis für erfolgreiches Schreiben.

Was passiert nun, wenn KI-Chatbots dazu kommen?

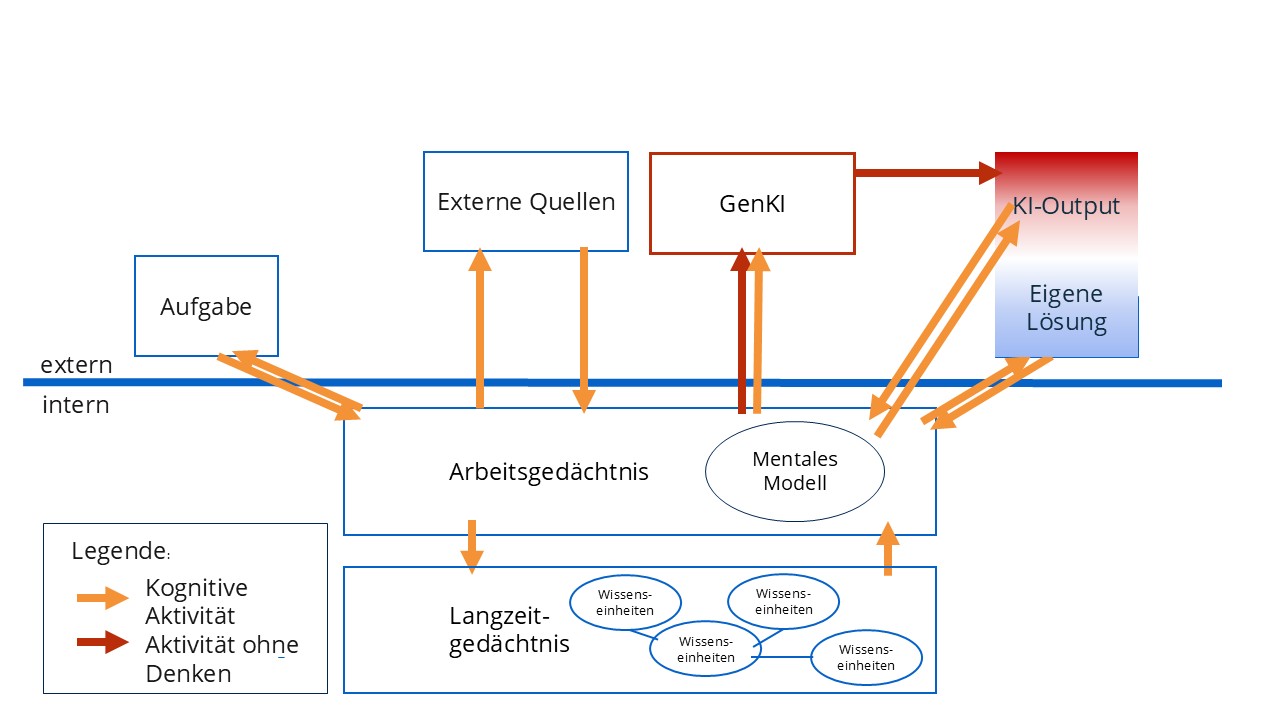

Sprachmodelle wie ChatGPT können in diesem Modell als eine zusätzliche, externe Quelle konzeptualisiert werden (vgl. Abb. 3). Wie andere externe Quellen, wie z.B. Publikationen können Schreibende den Output von KI kritisch verarbeiten und zur Weiterentwicklung ihrer mentalen Modelle nutzen und auch Inhalte davon ins Langzeitgedächtnis übernehmen. Da Chatbots anders als z.B. Publikationen eine Interaktion zulassen, kann auch diese Interaktion – im Idealfall – die Verarbeitung unterstützen, da die Prozesse des Anfragens/Promptens und Re-Repräsentieren des KI-Outputs die Verfeinerung des mentalen Modells vorantreiben können (vgl. Abb. 3).

Abb. 3: Modell des Schreibens mit KI im Sinne einer kompetenten Nutzung

Lassen die Schreibenden die Prozesse des eigenen Externalisierens und Re-Repräsentierens des eigenen Schreiboutputs nicht weg, sondern reichern sie durch die Arbeit mit KI und deren Output an, so kann der sogenannte Co-Intelligenz-Effekte (Mollick, 2024) zum Tragen kommen:

- Es können bessere Schreibprodukte entstehen (innerhalb derer es übrigens nicht mehr möglich ist, zu unterscheiden, was von der KI und was von den Schreibenden geschrieben wurde, da es ein kollaborativer Prozess war – was des Weiteren übrigens auch nicht möglich ist, wenn Studierende aus einem Gespräch mit einer Lehrperson oder Kommiliton:innen Gedanken aufgreifen).

- Und das Denken und Lernen kann zusätzlich angeregt werden.

Wenn Schreibende den Schreibauftrag jedoch schlicht an die KI „weiterreichen“ und deren Ergebnis übernehmen, entfallen quasi alle kognitiven Prozesse: Kein Abgleichen, keine Reflexion, keine eigene Modellbildung – Denken und Lernen werden ausgeschaltet, was Abb. 4 verdeutlicht. Hier wird KI zum Offloading eingesetzt.

Abb. 4: Offloading-Situation

Als Lehrende möchten wir natürlich verhindern, dass Studierende dieses Offloading betreiben.

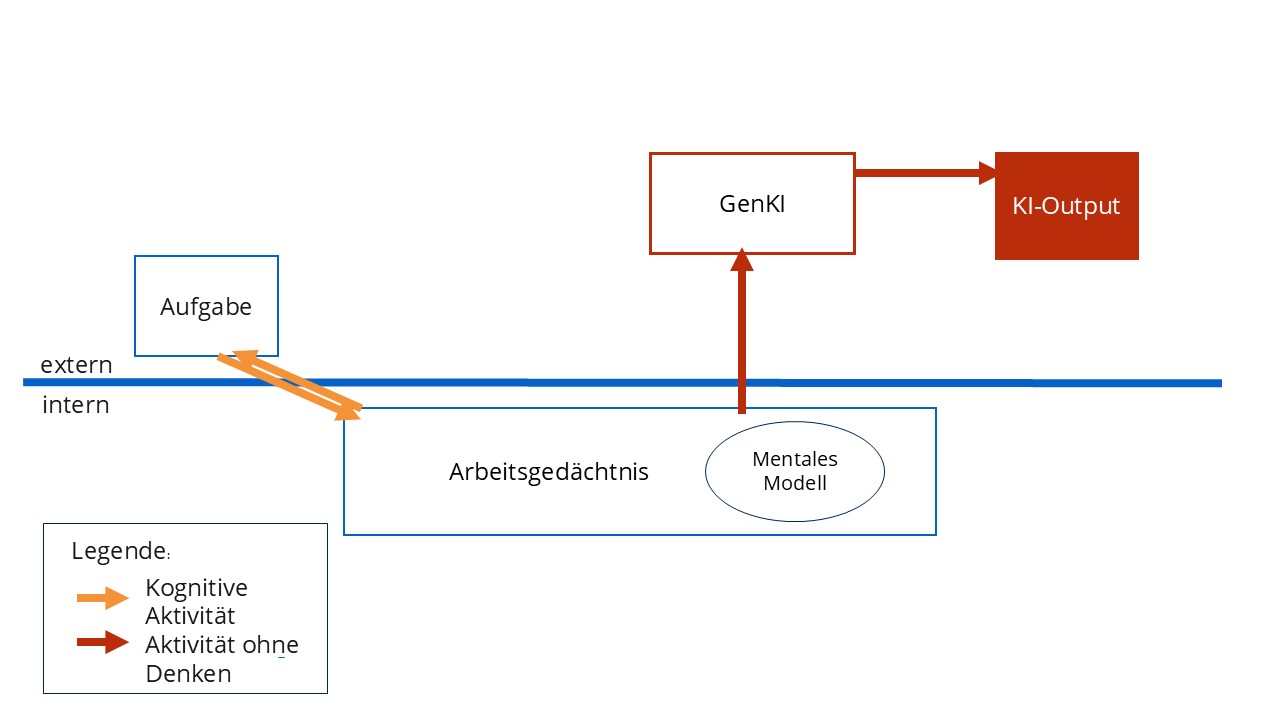

Es gibt aber auch noch eine andere Gefahr, die man auch in diesem Modell verdeutlichen kann, und die wir für sehr viel größer halten: Es ist die Gefahr der sogenannten „Overreliance“ (vgl. Deng, 2025 u.a., vgl. Abb. 5), denn dies bedient das menschliche Bestreben nach Zeitersparnis und ein z.T. ungerechtfertigtes Vertrauen in den Output von KI. Gleichzeitig spricht es natürlich auch für ein Fehlen von Kompetenzen im Umgang mit KI.

Abb. 5: Overreliance-Situation

In diesem Fall nutzen die Schreibenden den Chatbot als einzige externe Quelle, d.h. ziehen keine wissenschaftlichen Publikationen etc. hinzu, sondern verlassen sich vollkommen auf das, was der Chatbot ausgibt. Sie arbeiten damit unwissenschaftlich, laufen Gefahr, Fehler nicht zu erkennen, erfundene Quellen zu zitieren etc. Zwar schalten sie durch die Interaktion mit dem Chatbot ihr Denken und Lernen nicht aus und lernen durch die kollaborative Zusammenarbeit am Schreibprodukt auch, aber sie könnten Falsches oder Fehlerhaftes lernen und weitergeben, denn sie verlassen sich auf maschinelle Plausibilität, statt auf wissenschaftliche Belegbarkeit.

Zudem besteht die Gefahr, dass durch das „Wiedererkennen“ von plausibel erscheinenden Inhalten des KI-Outputs weniger kognitive Auseinandersetzung passiert, da – und das ist typisch menschlich – die intensive kognitive Auseinandersetzung Anstrengung bedeutet, die wir eher vermeiden wollen. Wenn Menschen etwas vollständig in eigenen Worten ausdrücken bzw. schriftlich präzise formulieren, müssen sie den Inhalt stärker selbst durchdenken, als wenn sie einen von einem Chatbot generierten Inhalt lesen und für gut befinden. So ist z.B. wiederholtes Lesen nachweislich eine weniger effektive Lernstrategie als aktives Abrufen von Inhalten (Dunlosky et al. 2013).

Warum Forschung zu widersprüchlichen Ergebnissen kommt

Ob KI also Lernen und Denken unterstützt oder verhindert, hängt nicht davon ab, ob KI eingesetzt wird, sondern wie. Studien, die Offloading-begünstigende Aufgabenformate untersuchen, kommen zwangsläufig zu pessimistischen Ergebnissen (wie z.B. Bastani et al, 2024; Gerlich, 2024). Forschung, die die Arbeit an Aufgaben untersucht, die die Prozesse sichtbar machen, Reflexionen fördern und Quellenprüfung verlangen, zeigen dagegen positive Effekte (wie z.B. Abbas, Jam & Khan, 2024; Kavadella et al, 2024; Essel et al, 2024).

Was folgt daraus für Lehrende an Hochschulen?

Konsequenzen für die Hochschullehre

Für Lehrende bedeutet das vor allem Folgendes:

- Sie müssen Studierende im Umgang mit KI schulen und sie bei einem lernförderlichen Einsatz unterstützen.

- Sie müssen die sehr soliden psychologischen Erkenntnisse der unumgänglichen mentalen Prozesse beim Lernen verstehen und diese den Studierenden verdeutlichen

- Sie müssen diese Art des (Nach-)Denkens fördern und bewerten, nicht nur das Produkt betrachten.

- Sie müssen den Studierenden Vorteil dieser Art des Arbeitens näherbringen, der sie dazu befähigt, bessere Ergebnisse zu erzielen.

Die Frage darf nicht lauten, ob KI erlaubt ist, sondern wie sie sinnvoll eingebettet werden und wie KI-Kompetenzen bei Studierenden aufgebaut werden können. Studierende müssen verstehen lernen, dass die entscheidende Leistung nicht im Erzeugen von Texten liegt, sondern im Durchdringen von Inhalten – im Vergleichen, Abwägen und Überarbeiten. Das jedoch verlangt neue Formen der Aufgaben- und Prüfungsgestaltung und eine veränderte Rolle der Lehrenden. Sie sollten Studierende anregen, ihren Prozess transparent zu machen: Welche Schritte führten zum Ergebnis? Welche Entscheidungen trafen sie? Wie sind sie mit Unsicherheiten, Müdigkeit, Zeitdruck umgegangen? Eine solche Prozesssicht macht das Lernen nachvollziehbar – und schützt zugleich vor der Versuchung, das Denken zu delegieren.

Dieser Beitrag soll dazu anregen, darüber nachzudenken, wie dies in einem Arbeitsbündnis von Lehrenden und Lernenden gelingen kann.

Zugleich müssen wir mit den Studierenden offen über Risiken sprechen. Offloading und Overreliance sind keine moralischen Fehltritte, sondern nachvollziehbare Reaktionen auf Leistungsdruck und unklare Anforderungen. Aufgabe von Lehrenden ist es deshalb, diese Dynamiken bewusst zu machen und Räume zu schaffen, in denen Experimentieren inklusive Fehler machen, Umwege gehen und Zweifeln erlaubt ist.

Ein Ausblick: Lehrende zwischen Vertrauen und Verantwortung

Wir sind der Überzeugung, dass wir an einem Punkt angekommen sind, an dem wir die Hochschullehre neu denken müssen – nicht gegen, sondern mit der KI. Die Zukunft des wissenschaftlichen Schreibens wird nicht in der Abwehr technologischer Entwicklungen liegen (was sowieso nicht möglich ist, da KI schon jetzt vielfach im Hintergrund integriert ist, ohne dass wir es merken), sondern in der Förderung kompetenter Nutzung. Wir werden Lehrformen brauchen, die kritisches Denken, ethische Reflexion und technologische Mündigkeit verbinden.

Wenn wir es schaffen, Studierende dazu zu befähigen, KI als Unterstützung beim Denken zu nutzen – nicht als Ersatz –, dann kann diese Technologie menschliches Denken fördern und erweitern. Und vielleicht liegt darin eine Chance, Lehre menschlicher zu gestalten: weg von Kontrolle und Bewertung, hin zu Neugier, Vertrauen und echtem Erkenntnisinteresse.

Quellen

Abbas, M., Jam, F. A., & Khan, T. I. (2024). Is it harmful or helpful? Examining the causes and consequences of generative AI usage among university students. International Journal of Educational Technology in Higher Education, 21(1), 10. DOI: dx.doi.org/10.1186/s41239-024-00444-7

Bastani, H. et al (2024). Generative AI Can Harm Learning. The Wharton School Research Paper. Abrufbar unter: https://papers.ssrn.com/sol3/papers.cfm?abstract_id=4895486

Buck, I. & Limburg, A. (2024). KI und Kognition im Schreibprozess: Prototypen und Implikationen. Journal der Schreibwissenschaft 15 (1), 8-23

Deng, R., Jiang, M., Yu, X., Lu, Y., & Liu, S. (2025). Does ChatGPT enhance student learning? A systematic review and meta-analysis of experimental studies. Computers & Education, 227, 105224. https://doi.org/10.1016/j.compedu.2024.105224

Essel, H.B. et al (2024). ChatGPT effects on cognitive skills of undergraduate students: Receiving instant responses from AI-based conversational large language models (LLMs). Computer and Eduation: Artifical Intelligence 6. S. 6. Abrufbar unter: https://www.sciencedirect.com/science/article/pii/S2666920X23000772

Gerlich, M. (2024). AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking. Abrufbar unter SSRN: https://ssrn.com/abstract=5082524 or http://dx.doi.org/10.2139/ssrn.5082524

Glathe, A., Hanke, U., Klapproth, F., Mörth, M., Paridon, H. & Weber, T. (2025). Gute Noten – nichts gelernt? Vortrag auf dem University Future Festival 2025. Abrufbar unter: https://www.youtube.com/watch?v=f8Wx6FfZPZU

Hanke, U. (2007). Externale Modellbildung als Hilfe bei der Informationsverarbeitung und beim Lernen. Saarbrücken.

Kavadella, A., Dias da Silva, M.A., Kaklamanos, E.G., Stamatopoulos, V., & Giannakopoulos, K. (2024). Evaluation of ChatGPT’s Real-Life Implementation in Undergraduate Dental Education: Mixed Methods Study. JMIR Med Educ :e51344. Available at: JMIR Medical Education – Evaluation of ChatGPT’s Real-Life Implementation in Undergraduate Dental Education: Mixed Methods Study . doi: 10.2196/51344

Kleist, H. (1805/06). Über die allmähliche Verfestigung der Gedanken beim Reden.

Mollick, E. (2024). Co-Intelligence. Living and Working with AI. New York: Portfolio/Penguin.

Renkl, A. (2020). Wissenserwerb. In Wild, E. & Möller, J. (Hrsg). Pädagogische Psychologie (3. Vollständig überarbeitete und aktualisierte Auflage). Springer.

Richter, T. & Kubik, V. (2025). Wissenserwerb. In Urhahne, D., Dresel, M. & Fischer, F. (Hrsg.). Psychologie für den Lehrberuf (2. Auflage). Springer.

Hinterlasse einen Kommentar