Patricia Wohner

In unserem letzten Beitrag „KI beim wissenschaftlichen Schreiben: Wann sie Denken fördert – und wann sie es verdrängt“ haben wir uns mit der Frage beschäftigt, wie Studierende KI beim Schreiben lernförderlich einsetzen können. Dabei stand die konkrete Schreibpraxis im Mittelpunkt: Wann unterstützt KI den Denkprozess – und wann übernimmt sie ihn?

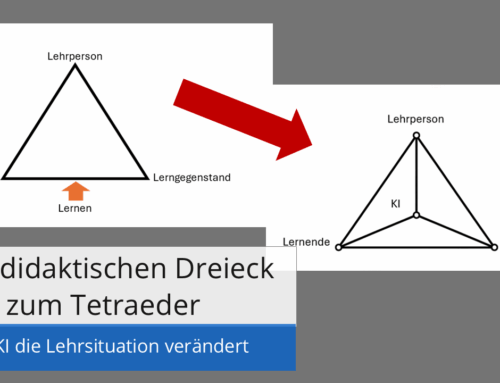

In diesem Beitrag wechseln wir die Perspektive: Wir richten den Blick nicht mehr auf die Studierenden als Schreibende, sondern auf uns Lehrende als Gestalter*innen von Lernprozessen. Die zentrale Frage lautet: Wie können wir didaktische Arrangements schaffen, die Studierende dazu befähigen, mit KI bewusst, selbstgesteuert und reflektiert zu lernen?

Um diese Frage zu beantworten, lohnt sich ein Blick in die Transaktionsanalyse.

In der Transaktionsanalyse gilt Autonomie – verstanden als Zusammenspiel von Bewusstheit, Spontaneität und Intimität – als zentrales Ziel menschlicher Entwicklung (Berne 2008). Mit der zunehmenden Verbreitung KI-basierter Anwendungen in unseren Bildungskontexten rückt einer dieser Teilaspekte von Autonomie in den Mittelpunkt didaktischer Überlegungen: die Bewusstheit der Lernenden. Auf diese Bewusstheit lege ich im Folgenden den Fokus bei meinen Überlegungen, denn ob die KI-Nutzung lernförderlich wirkt, entscheidet sich wesentlich daran, in welchem Maße Lernende KI BEWUSST einsetzen, also zielgerichtet nutzen und Ergebnisse kritisch reflektieren. Tun sie das nicht, lernen sie vermutlich wenig oder gar nichts. Lernen mit KI setzt damit ein hohes Maß an Bewusstheit voraus.

Wenn KI das Denken übernimmt – und Lernen auf der Strecke bleibt

Ein zentrales Risiko, das Sie vielleicht auch in Ihren Lehrveranstaltungen beobachten, ist das sogenannte Offloading: Studierende lassen die ihnen gestellten Aufgaben von der KI erledigen, anstatt sie selbst zu bearbeiten. In diesem Fall lernen sie nichts. Nur ist ihnen das vielleicht in einigen Fällen gar nicht wirklich bewusst, denn aus ihrer Sicht haben sie ja schließlich die KI-Antwort vielleicht noch gelesen und damit „gelernt“. Wir müssen unseren Studierenden also BEWUSST machen, was sie hier tun. Damit KI lernförderlich sein kann, muss Bewusstheit vorliegen. Die Studierenden müssen sich ihrer Ziele, Denkprozesse und Entscheidungsmechanismen im Umgang mit KI bewusst sein (vgl. Schröter 2025, S. 935).

Bewusstheit als didaktisches Prinzip: Drei Strategien nach Schröter (2025) – und ihre Umsetzung

Ausgehend von seiner Neun-Felder-Anwendungsmatrix von K. I. im Lernprozess zur Förderung von Achtsamkeit in Lernprozessen leitet Schröter (2025, S. 939) drei Strategien ab, die wir als Lehrende in unseren Lehrveranstaltungsplanungen integrieren können, um Bewusstheit beim Lernen zu unterstützen.

1. Informationskompetenz zu KI gezielt fördern

Wenn unseren Studierenden noch das fachliche Wissen fehlt, um KI-generierten Output unmittelbar auf Richtigkeit und Vollständigkeit zu prüfen, sind wir als Lehrende gefragt, sie darauf hinzuweisen, dass KI Fehler macht, welche Grenzen die KI hat und wie sie ihren Output generiert. Nur dadurch können sie auf Dauer das Maß an Bewusstheit erlangen, das nötig ist, künftig immer kritisch mit KI-Output umzugehen.

In der Lehre können wir das beispielsweise über Vergleichsaufgaben umsetzen, in denen eine KI-Zusammenfassung einem Fachtext gegenübergestellt wird. Hierzu fordern wir die Studierenden auf, einen Fachtext zunächst selbst zu lesen und für sich zusammenzufassen. Anschließend sollen sie den Text von einer KI zusammenfassen lassen, und dann ihre Erkenntnisse aus dem Text mit der KI-Zusammenfassung vergleichen. Was ist richtig? Was wird falsch oder missverständlich dargestellt? Was wird weggelassen, was besonders betont? An welchen Stellen werden Begriffe oder Kategorien unsauber verwendet?

2. Produktives Scheitern ermöglichen

Eine andere Möglichkeit ist, den sich selbst verstärkenden Kreislauf aus vermeintlich positiven Erfahrungen und wachsendem Vertrauen in KI-Output gezielt zu unterbrechen. Dazu können wir unsere Studierenden bewusst irritieren und Aufgaben bearbeiten lassen, die produktives Scheitern ermöglichen.

Ein Arbeitsauftrag könnte z.B. sein, Studierende eine komplexe fachliche Aufgabe mithilfe von KI bearbeiten zu lassen und so eine sprachlich wie strukturell überzeugende Lösung zu erstellen. In einer anschließenden Phase ohne KI-Zugang müssen sie zentrale Argumentationsschritte erläutern, auf eine Transferaufgabe anwenden oder ihre Lösung mündlich verteidigen. Dabei wird erfahrbar, dass ihr scheinbar vorhandenes Verständnis brüchig ist, weil kognitive Prozesse an die KI delegiert wurden und nicht als eigene Denkleistung verfügbar sind.

Eine andere Aufgabe könnte sein, einen Prompt zu rekonstruieren. In diesem Fall stellen wir den Studierenden ausschließlich einen finalen KI-Output zur Verfügung. Die Studierenden müssen nun rückwärts arbeiten und rekonstruieren, welche Anweisung zu genau diesem Ergebnis geführt haben könnte.

Studierende werden hier scheitern, denn es gibt keinen eindeutig rekonstruierbaren „richtigen“ Prompt hinter einem gegebenen Output. Diese Erfahrung, dass unterschiedliche Formulierungen zu ähnlichen, aber nie identischen Ergebnissen führen, dürfte das lineare Input-Output-Denken der Studierenden erschüttern und konfrontiert sie mit der probabilistischen Logik generativer Modelle.

3. Modeling durch Lehrende – Vorgehensweisen aufzeigen

Eine weitere Möglichkeit ist, dass wir als Lehrende unseren Studierenden zeigen und dabei laut denken, wie wir die Vertrauenswürdigkeit von Quellen und Aussagen prüfen. Dieser Ansatz wird in der Didaktik auch als Modeling bezeichnet. Die Studierenden lernen dadurch Vorgehensweisen kennen und können diese anschließend nachahmen und anpassen.

Wirkungsvoll kann Modeling u.a. dann sein, wenn Lehrende nicht einfach nur ihr Vorgehen demonstrieren, sondern bewusst auch eigene Fehler im Umgang mit KI sichtbar machen. Wer laut denkend einen Prompt formuliert, ein unbefriedigendes Ergebnis erhält und dann transparent macht, warum das Ergebnis problematisch ist und wie sich der nächste Schritt anpassen lässt, zeigt Studierenden, dass kritischer Umgang mit KI kein linearer Prozess ist, sondern ein iteratives Abwägen und Korrigieren. Ein solches Modeling kann die Hemmschwelle bei den Studierenden senken, Unsicherheiten offen anzusprechen.

Fazit

Lernen mit KI ist dann wirksam, wenn unsere Studierenden aktiv, selbstgesteuert und reflektiert mit KI arbeiten, d.h. wenn sie Bewusstheit zeigen oder Achtsamkeit im Sinne von Schröter. Zeigen sie Bewusstheit, werden sie aktiv mit der KI arbeiten und nicht die Aufgaben komplett an die KI abgeben (Offloading).

Für unsere didaktische Praxis bedeutet dies: Studierende müssen systematisch zu Bewusstheit angeregt werden. Wir als Lehrende übernehmen dabei eine Schlüsselrolle: nicht als Kontrollinstanz über KI-Nutzung, sondern als Gestalter*innen lernförderlicher Arrangements, in denen kritisches Denken, Reflexion und Selbstverantwortung explizit eingeübt werden.

Wie schon im letzten Beitrag zum wissenschaftlichen Schreiben aufgezeigt: Ob gelernt wird oder nicht, hat nichts damit zu tun, ob KI eingesetzt wird, sondern wie. Und zu diesem Wie können wir als Lehrende die Studierenden anleiten und begleiten.

Literatur

Berne, Eric (2008): Spiele der Erwachsenen. Psychologie der menschlichen Beziehungen. Reinbek bei Hamburg: Rowohlt.

Schröter, T. (2025): DrAI gewinnt? Eine konstruktivistische Anwendungsmatrix von K. I. im Lernprozess. In: Die Hochschullehre, 11, 935-941.

Hinterlasse einen Kommentar